Braunschweig. Digitale Sprachassistenten haben ihren Weg in den Alltag gefunden. Sie ermöglichen eine komfortable Interaktion mit elektronischen Geräten durch natürliche Sprache. Im Business-to-Business-Bereich jedoch beschränken fehlende Datensouverinität und offene Datenschutzfragen den Einsatz solcher Systeme. Die Technische Universität Braunschweig beteiligt sich im Verbundprojekt SPEAKER an der Entwicklung einer deutschen rechtskonformen KI-Sprachassistenzplattform. Die Forscherinnen und Forscher aus Braunschweig bringen dabei der Sprachassistenzplattform das „Sehen“ bei. Dies berichtet die TU Braunschweig in einer Pressemitteilung.

Die TU Braunschweig entwickele gemeinsam mit 19 Partnern aus Industrie und Wissenschaft im Verbundprojekt SPEAKER eine deutsche Sprachassistenzplattform. Sie werde europäische Standards in puncto Datensicherheit und Datenhoheit erfüllen und für den professionellen Einsatz geeignet sein. Die Plattform solle dabei offen, modular und skalierbar sein.

"Eine solche nationale Sprachassistenzplattform stellt nicht nur die Einhaltung des nationalen und europäischen Datenschutzrechts gegenüber dem Einzelnen sicher. Sie hilft auch dabei, Industriespionage oder ähnlichen Gefahren für unsere Gesellschaft vorzubeugen“, sagt Professor Tim Fingscheidt, Projektleiter seitens der TU Braunschweig.

Spracherkennung in lauter Umgebung weniger störanfällig

Für SPEAKER würden die Forscherinnen und Forscher der TU Braunschweig Kameradaten mittels künstlicher Intelligenz für den Sprachassistenten nutzbar machen. Die so gewonnenen Daten würden so die mikrofonbasierte Spracherkennung unterstützen. Diese sogenannte Informationsfusion aus akustischen und visuellen Daten könne insbesondere in akustisch gestörten Umgebungen – wie in Produktionsanlagen oder an öffentlichen Info-Terminals – helfen, die Spracherkennung weniger fehleranfällig und deutlich präziser zu gestalten. Dabei werde aus den anonymisierten Kameradaten ausschließlich die Mundregion extrahiert und über die Bewegungen der Lippen werden – wie beim menschlichen Lippenlesen – Informationen über die gesprochenen Worte gewonnen. Für die Spracherkennung werden moderne neuronale Faltungsnetze genutzt, die in den letzten Jahren für große Fortschritte im Bereich der Bildanalyse gesorgt haben.

Einsatzbereiche von KI-basierter Spracherkennung

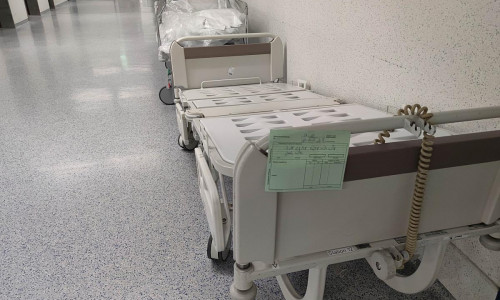

Sprachassistenten auf der Basis von künstlicher Intelligenz (KI) werde für Branchen wie den Gesundheitssektor, das Finanzwesen und die produzierende Industrie 4.0 wichtige Zukunftsperspektiven bieten. In der medizinischen Behandlung etwa könnten Sprachdialogsysteme Ärztinnen und Ärzte, Pflegerinnen und Pflegern unterstützen. So könnten sie Patientendaten freihändig – also ohne Tastatureingaben – abfragen, berührungslos medizinische Geräte bedienen und Diagnosen via Spracheingabe dokumentieren.

In der Industrie würden Sprachassistenten bei der digitalen Inspektion und Qualitätssicherung von Maschinen, Fahrzeugen oder Infrastrukturen große Vorteile bringen. Service- und Verwaltungsprozesse könnten mit dialogbasierten Assistenten effizienter gestaltet werden. Bei allen Anwendungen gelte es jedoch, Technologie und Datensouveränität optimal in Einklang zu bringen, damit besonders deutsche Unternehmen Sprachassistenzsysteme gezielt und sicher für sich nutzen könnten.

Am Institut für Nachrichtentechnik (IfN) der TU Braunschweig würden Wissenschaftler bereits seit den 1960er-Jahren an automatischer Spracherkennung forschen und arbeiten dabei in jüngerer Zeit mit modernen Methoden der künstlichen Intelligenz und des Deep Learnings in den Forschungsbereichen Sprachverarbeitung und Bildanalyse. Insbesondere im Forschungsgebiet der Informationsfusion verfüge das IfN über einschlägige und langjährige Erfahrungen. Im Jahr 2017 erhielt das IfN für Grundlagenforschung zu der im Projekt zu entwickelnden audiovisuellen Spracherkennung den Preis der Informationstechnischen Gesellschaft (ITG) im Verband der Elektrotechnik, Elektronik, Informationstechnik (VDE).